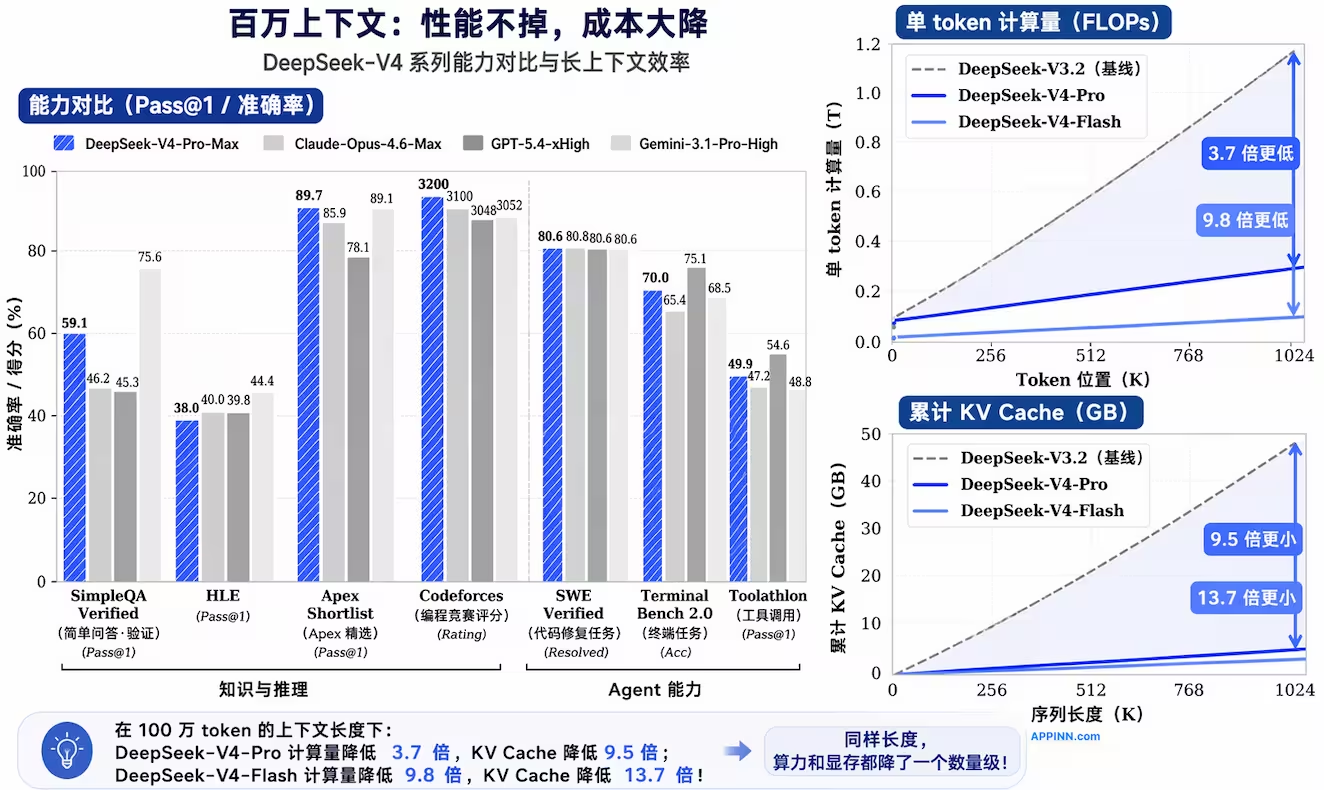

DeepSeek V4 终于发布了,带来了 1M 上下文,代码能力明显提升,推理进入第一梯队,但知识类能力仍落后于头部闭源模型。

最重要的是:「DeepSeek-V4 开创了一种全新的注意力机制,在 token 维度进行压缩,结合 DSA 稀疏注意力(DeepSeek Sparse Attention),实现了全球领先的长上下文能力,并且相比于传统方法大幅降低了对计算和显存的需求。从现在开始,1M(一百万)上下文将是 DeepSeek 所有官方服务的标配。」

算力需求比 V3.2 降低 3~10 倍

右侧显示,单 token 计算量(FLOPs)对比:

- V4-Pro 比 V3.2 降低 3.7 倍

- V4-Flash 比 V3.2 降低 9.8 倍

也就是说,同样的显卡和显存,可以处理更多的请求了(利好大模型提供商)

与同行对比

| 指标 | GPT-5.4 | Claude Opus 4.6 | Gemini 3.1 Pro | DeepSeek V4 Pro-Max |

|---|---|---|---|---|

| MMLU-Pro | 87.5 | 89.1 | 91.0 | 87.5 |

| SimpleQA | 45.3 | 46.2 | 75.6 | 57.9 |

| GPQA Diamond | 93.0 | 91.3 | 94.3 | 90.1 |

| HLE | 39.8 | 40.0 | 44.4 | 37.7 |

| LiveCodeBench | – | 88.8 | 91.7 | 93.5 |

| Codeforces | 3168 | – | 3052 | 3206 |

| Apex Shortlist | 78.1 | 85.9 | 89.1 | 90.2 |

另外,今天更新了 GPT-5.5,也是同一天啊,ChatGPT 中已经可用。

降价了吗?

降了,也没降:

| 模型 | 输入(缓存命中) | 输入(未命中) | 输出 | 上下文 |

|---|---|---|---|---|

| V3.2 | 0.2 元 | 2 元 | 3 元 | 128K |

| V4 Flash | 0.2 元 | 1 元 | 2 元 | 1M |

| V4 Pro | 1 元 | 12 元 | 24 元 | 1M |

V4 Flash 降价,V4 Pro 全面涨价。

值不值?

V4 Pro 比 V3.2 贵了这么多,值不值:

| 类别 | 指标 | V3.2 | V4-Pro | 提升情况(Pro) |

|---|---|---|---|---|

| 知识 | MMLU-Pro | 65.5 | 73.5 | ↑ +8.0 |

| 知识 | C-Eval | 90.4 | 93.1 | ↑ +2.7 |

| 知识 | MultiLoKo | 38.7 | 51.1 | ↑↑ +12.4 |

| 事实问答 | SimpleQA | 28.3 | 55.2 | ↑↑ +26.9 |

| 事实问答 | FACTS | 27.1 | 62.6 | ↑↑ +35.5 |

| 推理 | BBH | 87.6 | 87.5 | ≈ |

| 推理 | HellaSwag | 86.4 | 88.0 | ↑ +1.6 |

| 推理 | WinoGrande | 78.9 | 81.5 | ↑ +2.6 |

| 代码 | HumanEval | 62.8 | 76.8 | ↑↑ +14.0 |

| 数学 | MATH | 60.5 | 64.5 | ↑ +4.0 |

| 数学 | GSM8K | 91.1 | 92.6 | ↑ +1.5 |

| 长上下文 | LongBench-V2 | 40.2 | 51.5 | ↑↑ +11.3 |

现在就能用啦

目前 DeepSeek 官网以及 API 都上线了 V4。

原文:https://www.appinn.com/deepseek-v4/

能自己部署吗?

应该是不能的,Flash 最低也要200GB内存往上了。